Autore: Daniele Lazzarin - Tempo di lettura 9 minuti.

Il settore dell’hardware enterprise sta vivendo un vero e proprio momento d’oro grazie alla concomitanza di tre fattori favorevoli. Una è l'intelligenza artificiale, che sta spingendo a livelli che solo 3 anni fa erano inimmaginabili le crescite di server, storage e processori. Una seconda sono i data center di nuova generazione, che stanno ridefinendo i requisiti di computing, storage, networking, alimentazione e raffreddamento. La terza è l’hybrid computing - l’orchestrazione dinamica dei workload tra ambienti cloud, onpremise e edge – che in molte imprese ed enti pubblici, con il crescere delle esigenze di controllo dei costi, sicurezza e sovranità digitale, sta diventando un imperativo strategico.

Questa la tesi principale del recente “2026 Global Hardware and Consumer Tech Industry Outlook” di Deloitte, che approfondisce questi concetti con un’analisi molto ricca di dati, di cui qui riprendiamo solo alcuni aspetti sulla domanda enterprise, integrandoli con i più recenti dati di mercato.

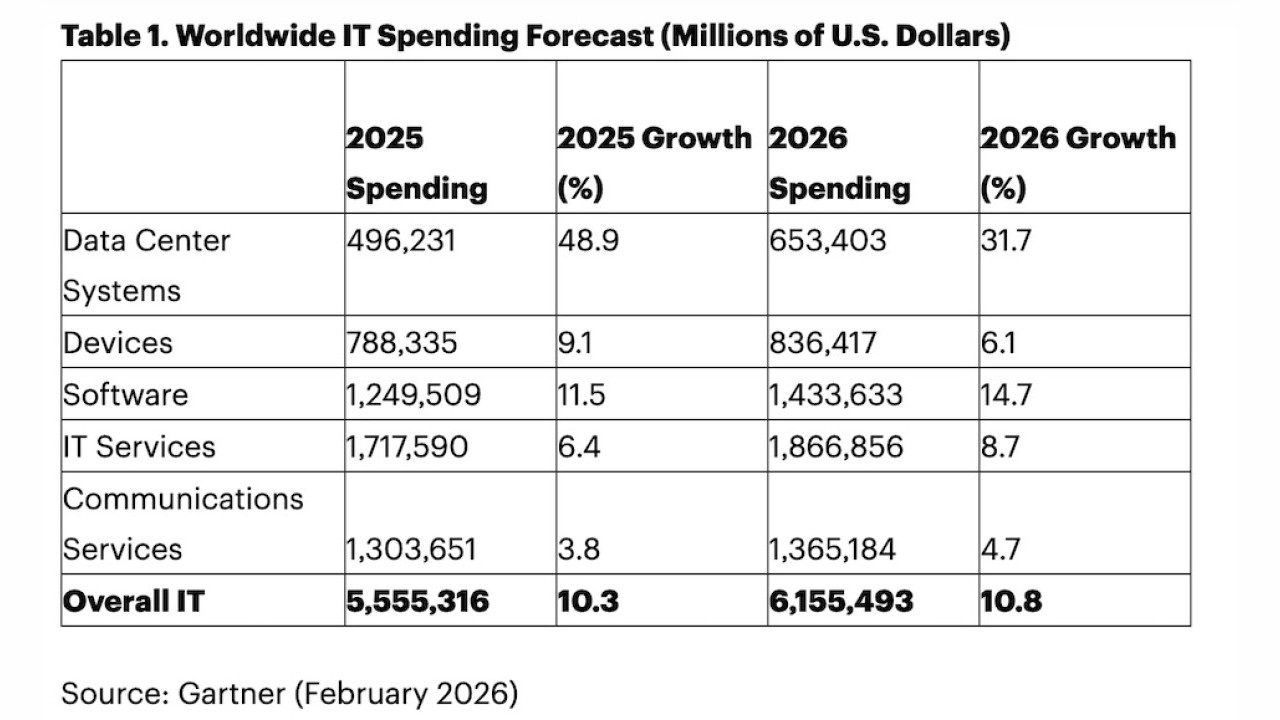

Cominciamo dalla previsione di spesa IT mondiale del 2026, che secondo l’aggiornamento più recente di Gartner sarà di 6150 miliardi di dollari (+10,8% rispetto al 2025), di cui oltre 653 miliardi per i sistemi per data center, che si contraddistinguono come il comparto a più alta crescita (+31,7%, dopo il +48,9% del 2024) grazie appunto alla domanda di infrastrutture per l'intelligenza artificiale.

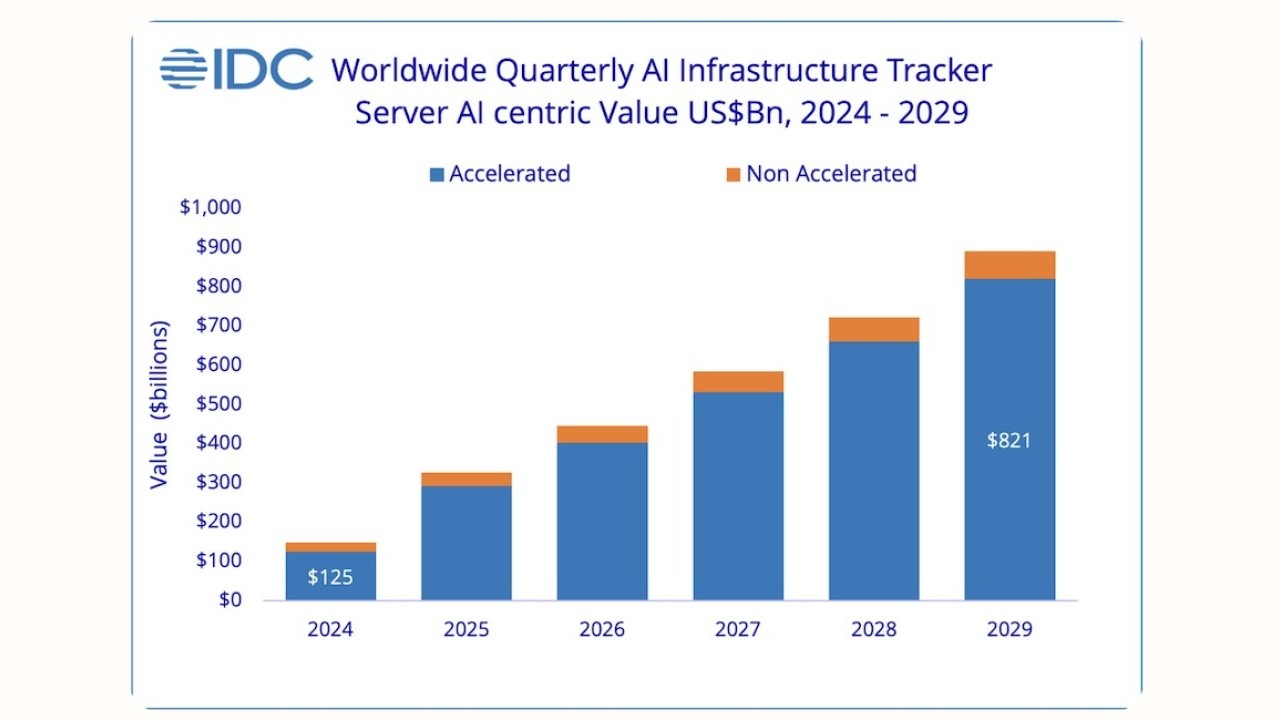

Infrastrutture per l’AI che secondo l'IDC Worldwide Quarterly Artificial Intelligence Infrastructure Tracker, nel terzo trimestre del 2025 hanno fatto segnare una spesa globale record: 86 miliardi di dollari. Un record che nasce sia dagli ingenti investimenti di fornitori di piattaforme AI e cloud hyperscaler, sia dal passaggio cruciale, nelle organizzazioni utenti, dalla fase dei progetti pilota a quella degli investimenti pluriennali nell’intelligenza artificiale. Di questi 86 miliardi, i server rappresentano la porzione dominante (84 miliardi, il 98%), mentre lo storage ottimizzato per l’AI ha raggiunto in valore 1,76 miliardi, trainato dalla domanda di repository ad alte prestazioni per l'addestramento dei modelli e i checkpoint di inferenza.

Per l'intero 2026, IDC stima una spesa totale in infrastrutture per l’AI oltrepasserà i 334 miliardi di dollari, che saliranno a oltre 900 miliardi entro il 2029, con tassi di crescita oltre il 30% annuo fino al 2027, per poi “scendere” intorno al 20-25% annuo.

Questo trend di crescita è alimentato anche dal mercato dei semiconduttori, che secondo i dati dell’associazione di categoria WSTS ha raggiunto un valore di 795,6 miliardi di dollari, in crescita del 26,2% rispetto al 2024, e potrebbe toccare i mille miliardi quest’anno, trainato proprio dai processori per l’intelligenza artificiale. Forse però i numeri che più danno l’idea dell’eccezionale impennata del mercato hardware sono quelli dei server. Tre anni fa, nel 2023, la domanda enterprise, spinta alla prudenza dalle crescenti complicazioni del quadro macroeconomico, aveva provocato in questo comparto un calo delle consegne addirittura del 19,4% (dati IDC), anche se l’aumento del prezzo medio del singolo server aveva fatto crescere il mercato in valore.

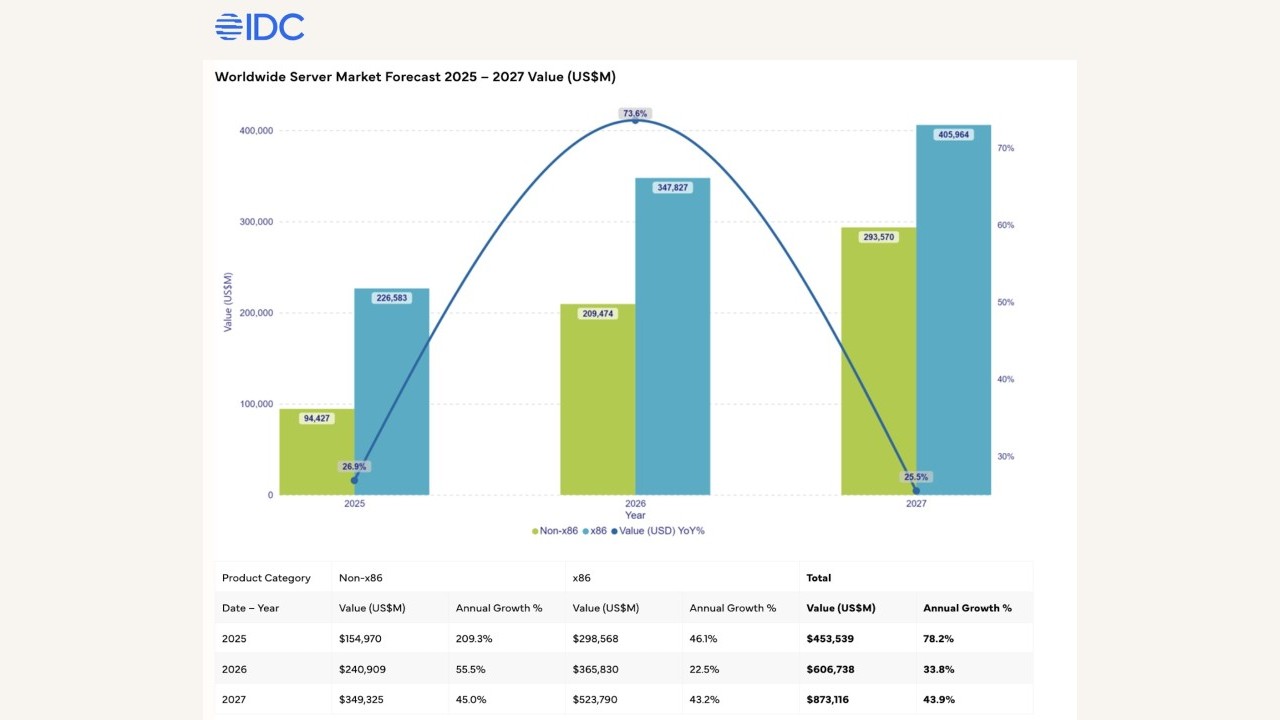

Solo due anni dopo, nel 2025, sempre secondo IDC il mercato mondiale dei server è cresciuto di oltre il 70% rispetto al 2024, trainato dai server “non-x86” – più adatti ai carichi di lavoro AI/Cloud – che hanno triplicato le vendite in un anno, contro il pur notevole +46% dei più “tradizionali” server x86.

Non si tratta di un trend di breve periodo. Anche se con numeri meno clamorosi di questi, la crescita del mercato server secondo le previsioni continuerà almeno per cinque anni, con un tasso medio del 24%.

Questi numeri hanno spinto alcuni produttori di server ad aumentare di due o tre volte i tassi di crescita stimati fino al 2030 rispetto a tre anni fa. La domanda di server AI per i data center secondo Deloitte rappresenta ormai tra il 20% e il 70% del fatturato previsto dai cinque principali player del mercato: Cisco, Dell, HPE, Lenovo e Supermicro. Mentre infatti la produzione di PC e server “non AI” è un settore molto maturo, con margini e opportunità di differenziazione molto bassi, i server per l’AI - sia quelli per i grandi data center degli hypervisor, sia quelli destinati all’on-premise di aziende ed enti pubblici – sono molto più complessi, e soprattutto evolvono praticamente giorno per giorno nelle dotazioni di processori e nelle configurazioni, dando più occasioni ai produttori di differenziarsi.

Se queste sono le prospettive per i server e i chip, gli investimenti nei progetti AI e nei data center stanno facendo crescere ad alti tassi anche altri comparti hardware. Per esempio i rack ad alta potenza tipici dell’AI richiedono sistemi di distribuzione dell’energia e soluzioni di raffreddamento a liquido (liquid cooling), progettate ad hoc, ed entrambi questi mercati sono per ora piccoli, ma in rapida crescita. Il mercato “power supply” per i server AI crescerà da 1,5 miliardi di dollari nel 2024 a oltre 31 miliardi nel 2028, mentre il mercato delle soluzioni liquid cooling crescerà di cento volte, da 300 milioni di dollari nel 2024 a oltre 30 miliardi nel 2028, spiega Deloitte, citando dati di JP Morgan. Ma i data center per l'AI necessitano anche di connessioni ultraveloci nei rack e tra i rack. Queste possono essere basate su rame (Ethernet o InfiniBand), ma molti si stanno spostando verso la fibra ottica, e questa transizione alimenta la crescita del mercato delle apparecchiature di networking per l’AI, che salirà da circa 8 miliardi di dollari nel 2023 a 34 miliardi nel 2028 (dati MorningStar).

Quanto allo storage, abbiamo visto che IDC per l’AI-centric storage stima un mercato di 1,76 miliardi per il terzo trimestre 2025. Con il passaggio del grosso dei workload AI verso l'inferenza nel 2026, spiega Deloitte, le memorie flash ad alta larghezza di banda (HBF) potrebbero emergere come alternativa alle memorie ad alta larghezza di banda (HBM) nei sistemi di AI integrati, aprendo potenzialmente nuove opportunità per i fornitori di storage flash “tradizionale”. L'HBF infatti promette di fungere da near-memory (situata vicino alla GPU o all’acceleratore), offrendo da 8 a 16 volte più capacità a un costo simile a quello dell'HBM.

Per il più ampio mercato dei sistemi di storage enterprise esterni (ESS), cioè non integrati direttamente nei server, IDC per il 2025 ha registrato un valore annuo record di 33 miliardi, in crescita del 3,9%. In particolare nel quarto trimestre 2025 la crescita è stata del 5,5%, grazie agli investimenti delle aziende nell'aggiornamento delle infrastrutture di storage precedentemente rimandati. Gli array All Flash sono il segmento trainante (+18,1% su base annua), ma a sorpresa crescono anche gli array di dischi rigidi (HDD, +3,1%), con una dinamica che sorprende solo in parte.

I forti aumenti dei prezzi di alcuni componenti come SSD, HDD e DRAM, di cui si parla da mesi, stanno impattando ovviamente anche sul mercato storage: alcune aziende affrettano gli approvvigionamenti per timore di ulteriori aumenti, altre stanno optando per soluzioni miste che includono appunto i sistemi HDD, precedentemente in forte calo, per contenere i costi. IDC prevede che la ripresa del mercato ESS si rafforzerà nel 2026, con un’ulteriore crescita del 7,1% rispetto al 2025, trainata in particolare dagli array all-flash (AFA) e ibridi flash (HFA), con gli AFA preferiti per i workload di AI ad alte prestazioni e gli HFA per i casi d'uso misti.

Il terzo fattore del momento d’oro dell’hardware enterprise, come accennato all’inizio, è l’affermarsi del modello “hybrid computing” nelle organizzazioni utenti. Per bilanciare costi, flessibilità, sicurezza e controllo del dato, c’è un rinnovato interesse nel “riportare in casa” almeno alcuni tipi di workload. Una tendenza che emerge anche in Italia, dove secondo l’Osservatorio Cloud del Politecnico di Milano nei nuovi progetti digitali delle grandi imprese nel 2025 le strategie cloud only e cloud first hanno perso entrambe 8 punti, e la scelta on-premise è cresciuta dal 6% al 12%.

Il cloud pubblico rimane il punto di partenza per gran parte dei progetti AI, perché offre accesso a modelli all'avanguardia e stack di risorse flessibili. Ma con la crescita dei workload AI, in particolare per il training e l'inferenza ad alto volume, i costi del cloud possono sfuggire di mano.

L'infrastruttura AI on-premise è un modo per contenere i costi, ma spesso utilizza modelli open source o self-hosted arretrati di mesi rispetto ai modelli cloud più avanzati. Trovare il giusto equilibrio è una delle principali sfide per le organizzazioni utenti. Molte stanno pianificando un'espansione pluriennale della capacità di calcolo in ambienti cloud, on-premise e edge, con strategie ibride dinamiche che distribuiscono i carichi di lavoro in base a considerazioni di costo, latenza, sovranità e sicurezza, nonché di disponibilità di energia, evitando di affidarsi pedissequamente agli hyperscaler.

Secondo Deloitte, la tradizionale dicotomia cloud-edge si sta frammentando. Le aziende opereranno probabilmente su quattro livelli di elaborazione distinti:

- Cloud pubblico, per l'accesso a modelli di frontiera sempre aggiornati e a infrastrutture su larga scala;

- Data center edge di operatori telco e service provider, per fruire di tempi di latenza brevi e gestione sovrana dei dati;

- Data center edge interni, per proteggere la proprietà intellettuale, garantire la disponibilità e gestire i dati sensibili;

- Dispositivi edge, ovvero smartphone, PC, veicoli, robot e sensori, per eseguire inferenze on-device ottenendo latenze estremamente basse e affidabilità offline.

Per il settore IT, conclude Deloitte, questa distribuzione dinamica dell'elaborazione AI può sbloccare nuove opportunità. I fornitori di servizi cloud possono offrire orchestrazione, osservabilità e governance in ambienti eterogenei, e non solo nelle proprie piattaforme. I fornitori hardware possono progettare acceleratori, reti e sistemi di raffreddamento per dispositivi con risorse energetiche limitate, ambienti edge ad alta resilienza e data center ad alta densità. Gli operatori telco possono riposizionare l’edge computing a livello metropolitano come un'offerta premium di "AI adiacente”. Infine i produttori di dispositivi possono sviluppare capacità di inferenza on-device, con domanda prevista in aumento dopo il 2026.