Nvidia svela Rubin: “La prossima frontiera dell’AI”

Il numero uno Jensen Huang ha aperto il CES 2026 presentando la nuova piattaforma “AI extreme-codesigned”, oltre a modelli open, robot, e una Mercedes guidata dall'AI

Quello del fondatore e CEO di NVIDIA Jensen Huang era uno dei discorsi più attesi al CES 2026 apertosi ieri a Las Vegas, e non ha deluso, mostrando come l'AI si sta espandendo in ogni area applicativa e in ogni dispositivo.

"Il computing è stato rivoluzionato dall'intelligenza artificiale," ha detto Huang. "Questo significa che circa 10 trilioni di dollari di computing dell'ultima decade saranno ora modernizzati per abilitare questo nuovo modo di fare computing".

Huang ha tra l’altro svelato Rubin, la piattaforma erede di Blackwell nonché la prima “AI extreme-codesigned” a sei chip di NVIDIA, ora in piena produzione, e ha introdotto Alpamayo, una famiglia di modelli di open reasoning per lo sviluppo di veicoli autonomi.

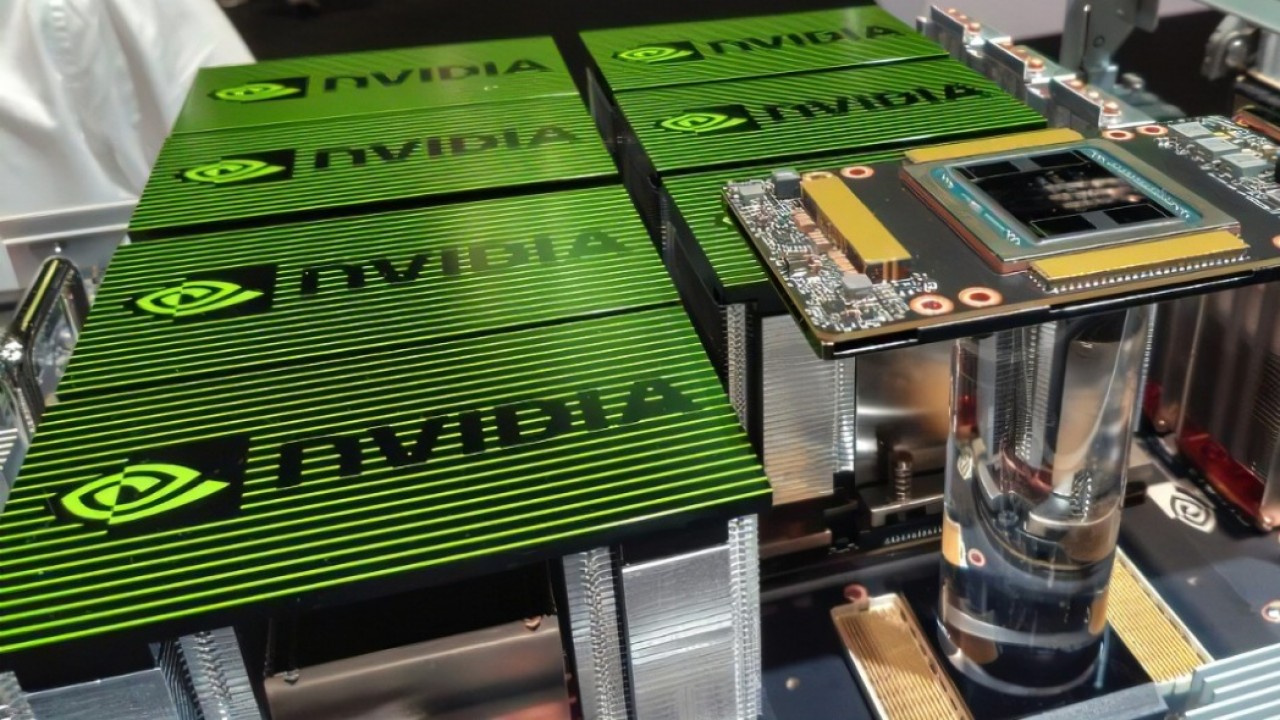

Un nuovo "motore" per l'AI: la piattaforma Rubin

Con Rubin, ha detto Huang, NVIDIA mira a spingere l'AI verso la prossima frontiera riducendo al contempo il costo di generazione dei token a circa un decimo rispetto alla piattaforma precedente, rendendo l'AI su larga scala molto più economica da implementare.

I principali componenti della piattaforma Rubin sono:

- GPU Rubin con 50 petaflops di inferenza NVFP4

- CPU Vera progettate per il movimento dati e l'elaborazione agentica

- Networking scale-up NVLink 6

- Networking scale-out Spectrum-X Ethernet Photonics

- SuperNIC ConnectX-9

- DPU BlueField-4

L'extreme codesign – cioè in sintesi la progettazione totalmente integrata e contemporanea di tutti questi componenti insieme - è essenziale, ha detto il numero uno di Nvidia, perché scalare l'AI richiede appunto un'innovazione strettamente integrata tra chip, rack, networking, storage e software per eliminare i colli di bottiglia e ridurre drasticamente i costi di training e inferenza.

Huang ha anche introdotto lo storage AI-native con NVIDIA Inference Context Memory Storage Platform - un tier KV-cache AI-native che potenzia l'inferenza a lungo contesto con 5 volte più token al secondo, 5 volte migliori prestazioni per dollaro di TCO e 5 volte migliore efficienza energetica.

Mettendo tutto insieme, la piattaforma Rubin promette di accelerare drammaticamente l'innovazione AI, fornendo token AI a un decimo del costo. "Più velocemente addestri i modelli AI, più velocemente puoi portare la prossima frontiera dell'innovazione nel mondo," ha detto Huang.

Modelli Open per sei settori: dalla sanità alla guida autonoma

I modelli open di NVIDIA - addestrati sui supercomputer proprietari di NVIDIA - stanno alimentando progressi in molti settori verticali, ha continuato Huang.

"Su questa piattaforma, NVIDIA è un costruttore di modelli AI di frontiera, e li costruiamo in modo aperto così da poter permettere a ogni azienda, ogni industria, ogni paese, di far parte di questa rivoluzione AI".

Il portafoglio copre sei domini --- Clara per la sanità, Earth-2 per le scienze climatiche, Nemotron per il ragionamento e l'AI multimodale, Cosmos per la robotica e la simulazione, GR00T per l'intelligenza embodied e Alpamayo per la guida autonoma - creando una fondazione per l'innovazione tra i vari settori.

AI su Ogni Scrivania: RTX, DGX Spark e Agenti Personali

Huang ha enfatizzato che il futuro dell'AI non riguarda solo i supercomputer, ma è anche personale.

Ha mostrato una demo con un agente AI personalizzato in esecuzione localmente sul supercomputer desktop NVIDIA DGX Spark e "incorporato" in un robot Reachy Mini attraverso modelli Hugging Face, per far capire come i modelli open, il routing dei modelli e l'esecuzione locale trasformano gli agenti in collaboratori fisici reattivi.

"La cosa sorprendente è che ora è del tutto banale, ma solo un paio di anni fa sarebbe stato impossibile, assolutamente inimmaginabile," ha detto Huang.

DGX Spark, precisa Nvidia, offre fino a 2,6 volte le prestazioni per i modelli di grandi dimensioni, con nuovo supporto per i modelli di immagini Lightricks LTX-2 e FLUX, e la prossima disponibilità di NVIDIA AI Enterprise.

Le novità per l'AI fisica

L'AI è ora radicata nel mondo fisico, attraverso le tecnologie NVIDIA per training, inferenza e edge computing, ha detto Huang. Questi sistemi possono essere addestrati su dati sintetici in mondi virtuali molto prima di interagire con il mondo reale.

Il numero 1 di NVIDIA ha poi presentato i modelli fondativi NVIDIA Cosmos addestrati su video, dati robotici e simulazione. Cosmos genera video realistici da una singola immagine, sintetizza scenari di guida multi-camera, modella ambienti edge-case da prompt di scenario, esegue ragionamento fisico e previsione di traiettoria, guida simulazioni interattive a circuito chiuso.

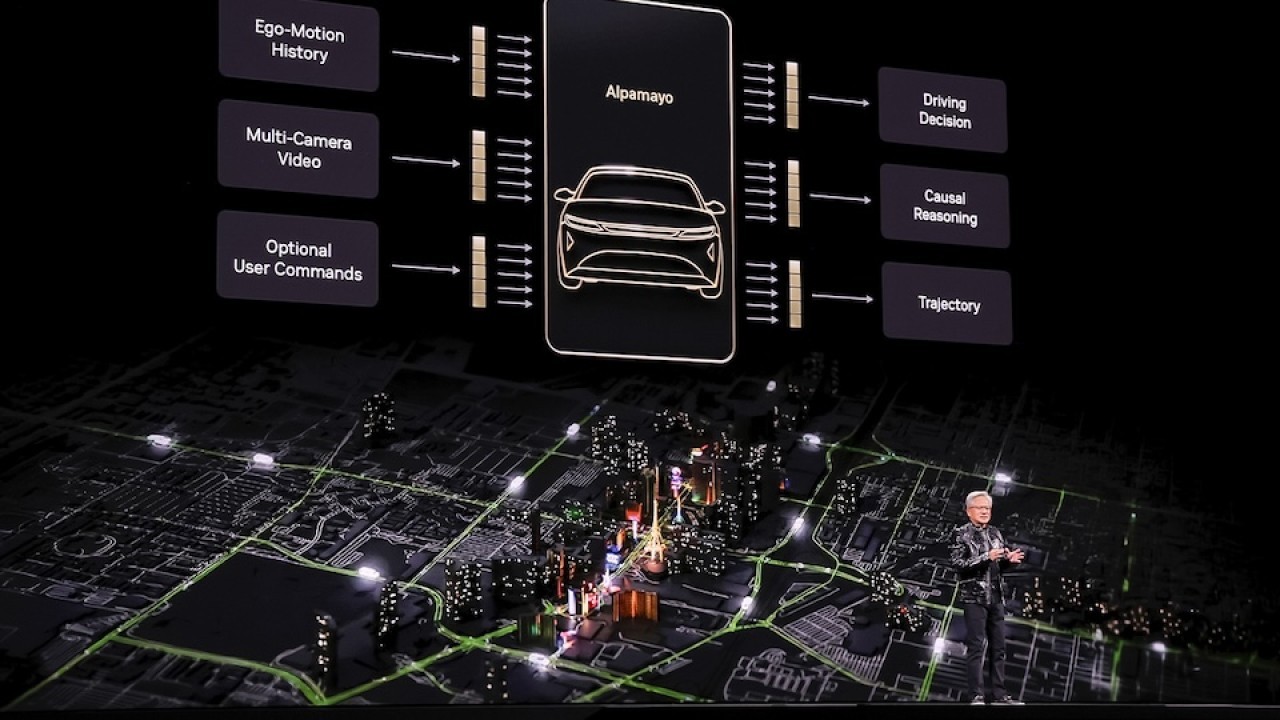

Sempre in questo campo Huang ha annunciato Alpamayo, un portfolio open di modelli di reasoning vision language action, blueprint di simulazione e dataset che abilitano l'autonomia di livello 4. Comprende Alpamayo R1, primo modello VLA di reasoning open per la guida autonoma, e AlpaSim, un blueprint di simulazione completamente open per test AV ad alta fedeltà.

"Non solo riceve input dai sensori e attiva il volante, i freni e l'accelerazione, ma ragiona anche sull'azione che sta per compiere", ha detto Huang, annunciando che la prima auto passeggeri dotata di Alpamayo costruita sulla piattaforma full-stack per veicoli autonomi Nvidia Drive sarà presto sulle strade. Si tratta della nuova Mercedes-Benz CLA, con guida definita dall'AI in arrivo negli Stati Uniti quest'anno, e dotata del rating di sicurezza a cinque stelle EuroNCAP della CLA.

Huang ha anche evidenziato il crescente slancio dietro DRIVE Hyperion, la piattaforma open, modulare, pronta per il livello 4 adottata da principali case automobilistiche, fornitori e provider di robotaxi in tutto il mondo. "La nostra visione è che, un giorno, ogni singola auto, ogni singolo camion sarà autonomo, e stiamo lavorando verso quel futuro".

"Gli impianti di produzione saranno robot giganti"

Huang è stato poi raggiunto sul palco da due piccoli robot mentre spiegava come l'approccio full-stack di NVIDIA stia alimentando un ecosistema globale di AI fisica, e ha mostrato un video che illustra come i robot vengono addestrati in NVIDIA Isaac Sim e Isaac Lab in mondi simulati fotorealistici.

Huang è apparso anche con il CEO di Siemens Roland Busch al keynote dell'azienda di martedì per annunciare una partnership ampliata, supportata da un montaggio che mostra come il full stack di NVIDIA si integra con il software industriale di Siemens, abilitando l'AI fisica dalla progettazione e simulazione fino alla produzione.

"Questi impianti di produzione saranno essenzialmente robot giganti", ha detto Huang, spiegando che NVIDIA ora costruisce sistemi completi perché serve uno stack completo e ottimizzato per fornire progressi nell'AI. "Il nostro compito è creare l'intero stack in modo che tutti voi possiate creare applicazioni incredibili per il resto del mondo".

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Redazione ChannelCity

Redazione ChannelCity